Vedomosti relatează: Duma de Stat a propus să atribuie inteligenței artificiale sarcina de a crește rata natalității în Rusia.

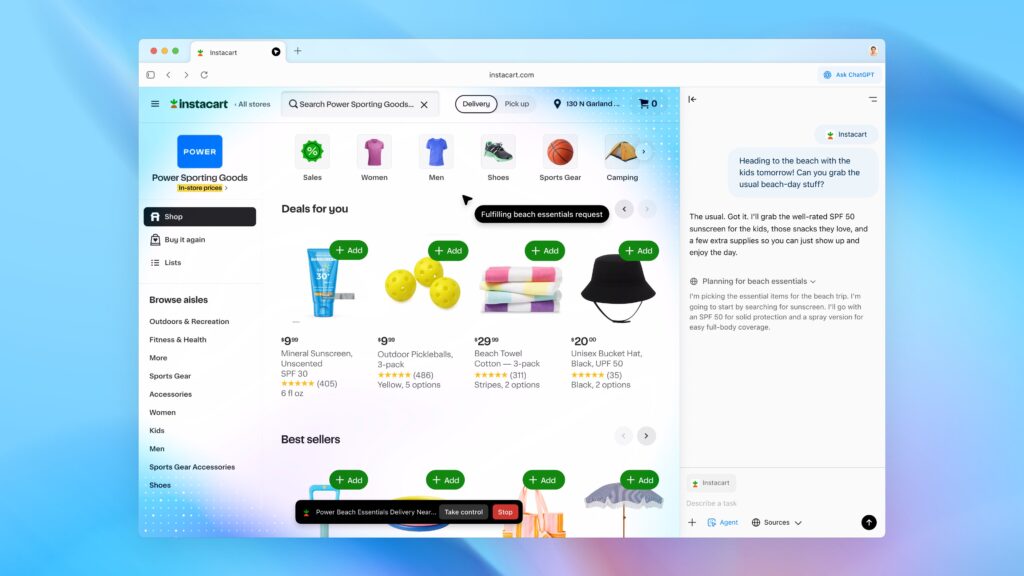

Nina Ostanina a declarat că inteligența artificială ar trebui să modeleze opțiunile de politici demografice pe baza principiului „ce-ar fi dacă”. Guvernul, a adăugat ea, pregătește deja un experiment pentru a introduce inteligența artificială în guvernare.

Experții pun la îndoială eficacitatea rețetelor digitale

Profesorul Alexander Safonov a explicat că fertilitatea este determinată de economie, nu de algoritmi. El a remarcat: „Trebuie să creăm interes în rândul populației”, dar, în același timp, „să transformăm situația economică din jurul familiei”. Inteligența artificială, consideră el, va îmbunătăți modelarea, dar nu va schimba cauzele fundamentale ale crizei.

Olga Pozdnyakova, șefa departamentului „Frontul Popular. Analiză”, a fost de acord: rețelele neuronale sunt potrivite pentru prognoze care iau în considerare condițiile economice, educația, asistența medicală și sentimentul social, dar datele demografice de bază rămân esențiale.

Rusia se confruntă cu cei mai slabi indicatori din ultimii 200 de ani

Scăderea ratei natalității a fost istorică: 1,22 milioane de copii s-au născut în țară în 2024 - cel mai mic număr din 1999. Între ianuarie și martie, numărul nașterilor a scăzut cu încă 11.500. În urma acestui fapt, Rosstat a încetat publicarea datelor detaliate. Proiectul național „Demografie” a eșuat, de asemenea: mortalitatea a depășit nașterile cu 3,4 milioane de persoane între 2018 și 2023.