Согласно новому аналитическому отчету Европола, о котором сообщает The Daily Telegraph, Европа может столкнуться с конфликтами между людьми и роботами уже к 2035 году.

В документе говорится, что роботизированные системы в ближайшие десять лет станут «неотъемлемой частью повседневности».

Эксперты отмечают, что роботы проникнут во все сферы жизни — от доставки до ухода за людьми. В ряде случаев машины смогут вытеснить людей с привычных рабочих мест. Это, по оценке аналитиков, создаст почву для социального напряжения и открытой агрессии.

Особый риск, как указывается в отчете, связан с «неблагополучными районами». Там возможны прямые нападения на роботов. Любые сбои в их работе способны перерастать в громкие общественные скандалы и усиливать недоверие к технологиям.

Отдельно Европол предупреждает о вероятном росте киберпреступности. Массовое внедрение роботизированных систем увеличит уязвимость цифровой инфраструктуры и создаст новые возможности для преступлений.

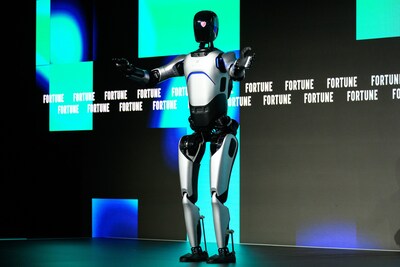

На фоне этих прогнозов упоминается недавний инцидент с гуманоидным роботом EngineAI Т800, который избил собственного создателя. В соцсетях этот случай вызвал полярную реакцию: одни увидели подтверждение угрозы со стороны машин, другие — признак неизбежного технологического прогресса.