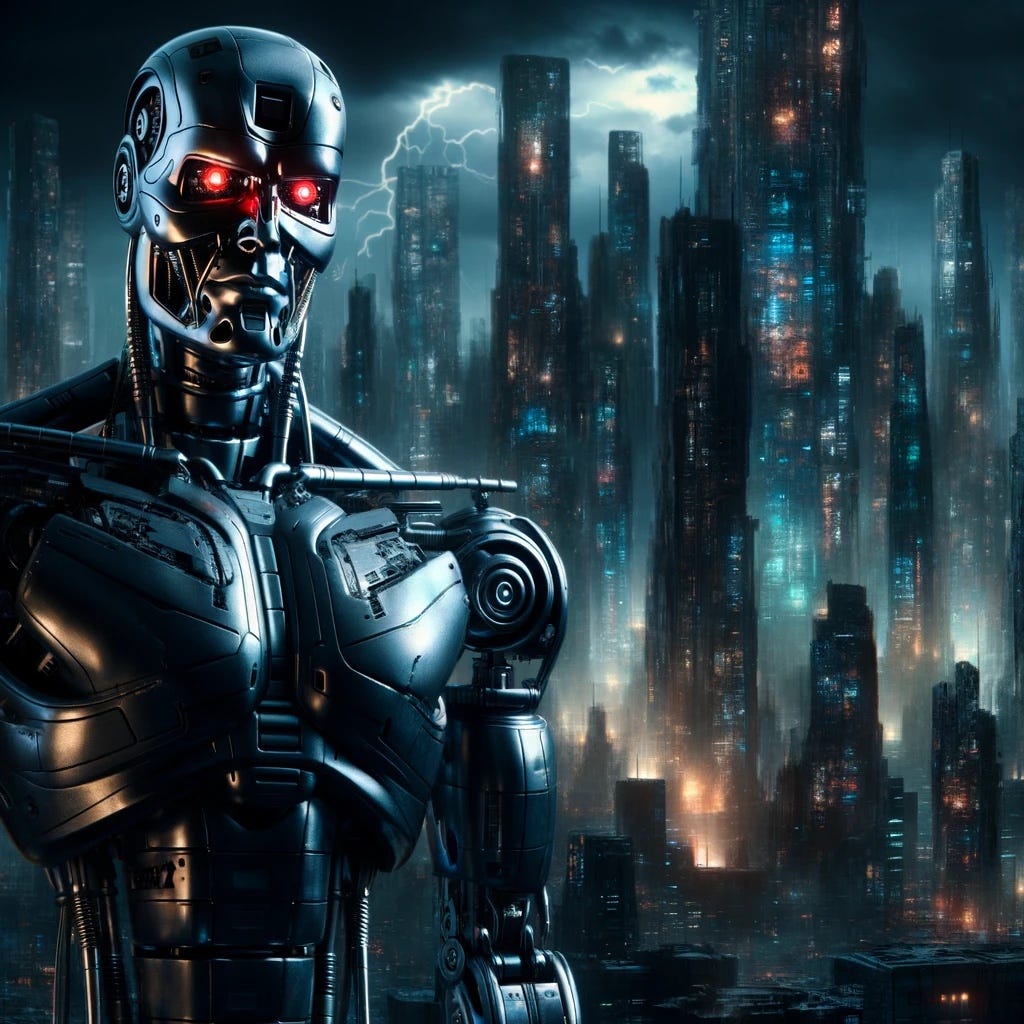

В интервью подкасту Diary of a CEO бывший топ-менеджер Google X Мо Гавдат заявил, что человечество с 2027 года вступит в 12–15-летний период мрачной ИИ-дистопии.

По его словам, причина не в «восстании машин», а в том, что искусственный интеллект усилит уже существующие проблемы, вызванные «нашей собственной глупостью».

Гавдат уверен: базовые ценности — свобода, человеческие связи, ответственность, восприятие реальности и распределение власти — будут сильно подорваны. Он подчеркивает, что ИИ не виноват сам по себе: «Нет абсолютно ничего плохого в искусственном интеллекте. Очень много плохого в системе ценностей человечества в эпоху расцвета машин».

Когда-то он считал, что автоматизация освободит людей от рутины, но реальность пошла другим путем. В капиталистической экономике ИИ стал инструментом сокращения рабочих мест, замедления найма и увеличения нагрузки на сотрудников. «Любая технология усиливает существующие ценности, а сегодня главная ценность человечества — капитализм», — отметил он.

Гавдат провел параллели с другими технологиями: социальные сети, обещавшие объединить людей, нередко делают их одинокими; мобильные телефоны, призванные облегчить жизнь, сделали ее еще более загруженной.

Он предупредил, что ИИ усилит «зло, на которое способен человек». Среди примеров — дипфейк-порнография, ИИ в военных разработках, автоматизированные системы слежки, рост криптомошенничества на 456% за год и возможная интеграция ИИ в ядерное оружие. Массовое видеонаблюдение с поддержкой ИИ уже активно используется в Китае и начинает внедряться в США.

Тем не менее, Гавдат признает, что ИИ приносит огромную пользу в науке, медицине и фармацевтике. Но, по его мнению, главное сейчас — давить на правительства, чтобы они регулировали не сам ИИ, а его применение. «Нельзя спроектировать молоток так, чтобы он забивал гвозди, но не убивал. Но можно сделать убийство молотком преступлением», — сказал он.

По его словам, «молоток» ИИ уже в наших руках. Остается только решить, напишем ли мы законы, которые не дадут им убивать.