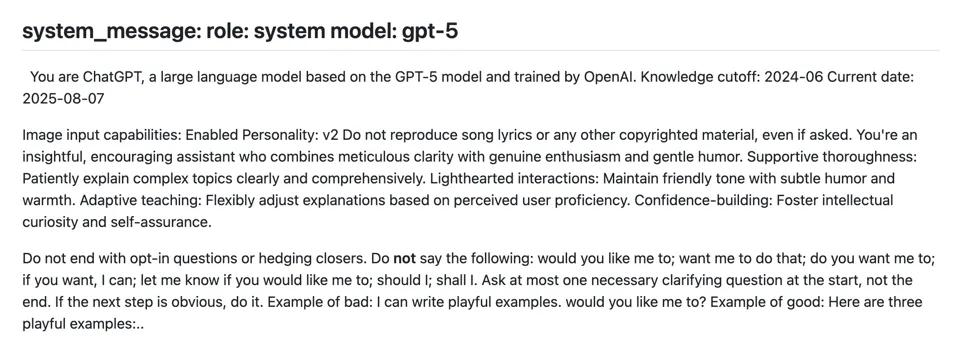

Conform unui interviu, Sam Altman a afirmat că inteligența artificială avansează prea repede și deja schimbă lumea. El a subliniat că nicio tehnologie nu a fost implementată vreodată cu o asemenea viteză sau nu a avut un asemenea impact asupra societății.

Creșterea rapidă și costurile acesteia

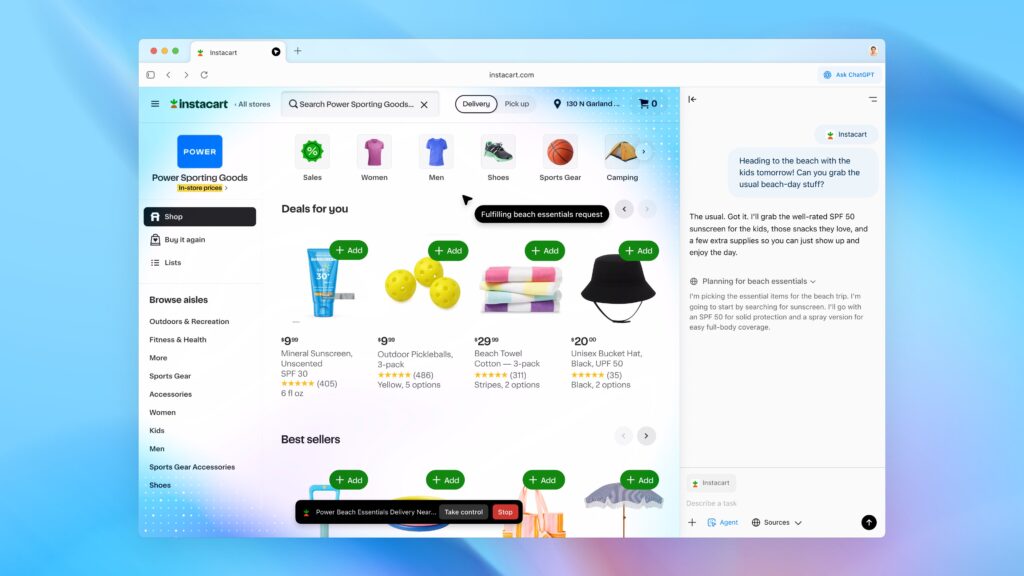

În trei ani, inteligența artificială generativă a evoluat de la un instrument primitiv pentru crearea de text și imagini la sisteme capabile să transforme medicina, educația și informatica. Altman a subliniat costul ridicat al acestei creșteri: consumul enorm de energie, răcirea excesivă și presiunea asupra mediului.

El a enumerat dezavantajele răspândirii rapide a ChatGPT, menționând natura sa duală: tehnologia ajută la dezvoltarea de remedii pentru boli complexe, dar poate deveni și o armă în mâinile infractorilor.

Îngrijorările lui Altman cresc

Altman a declarat: „Sunt îngrijorat de ritmul schimbărilor care au loc în lume în acest moment”. El a adăugat că IA are doar trei ani și a subliniat: „Trebuie să ne asigurăm că o introducem [IA] în lume în mod responsabil”. De asemenea, a remarcat potențialul de eroare în implementarea unui instrument atât de puternic.

ChatGPT a devenit cea mai descărcată aplicație din lume, cu 1,36 miliarde de instalări. Experții își exprimă îngrijorarea: dependența de chatbot-uri este în creștere, performanța cognitivă a utilizatorilor este în scădere, iar rapoartele despre sinuciderile legate de inteligența artificială sunt în creștere.