„ვედომოსტი“ იუწყება: სახელმწიფო დუმამ რუსეთში შობადობის გაზრდის ამოცანა ხელოვნური ინტელექტისთვის დაავალოს.

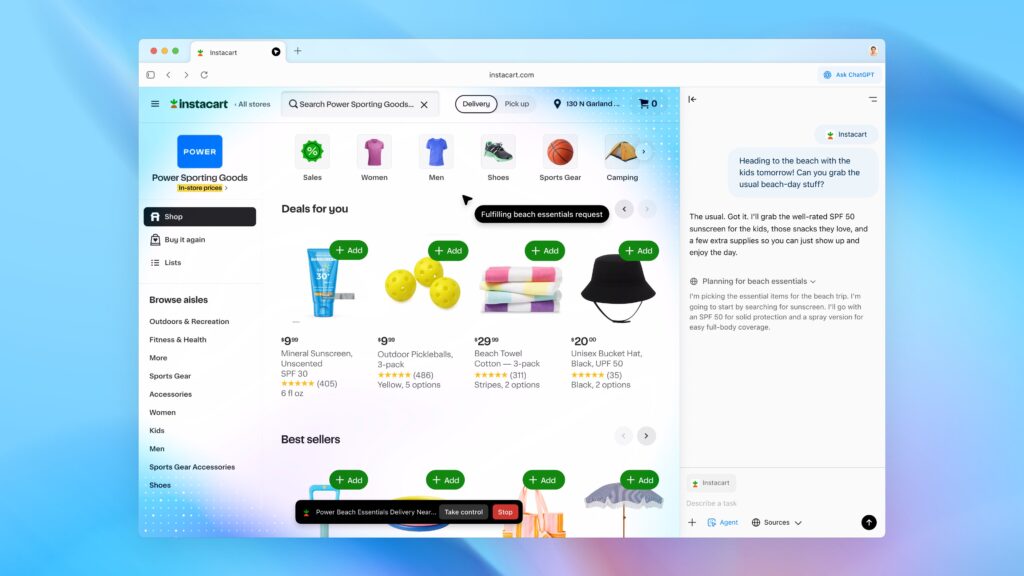

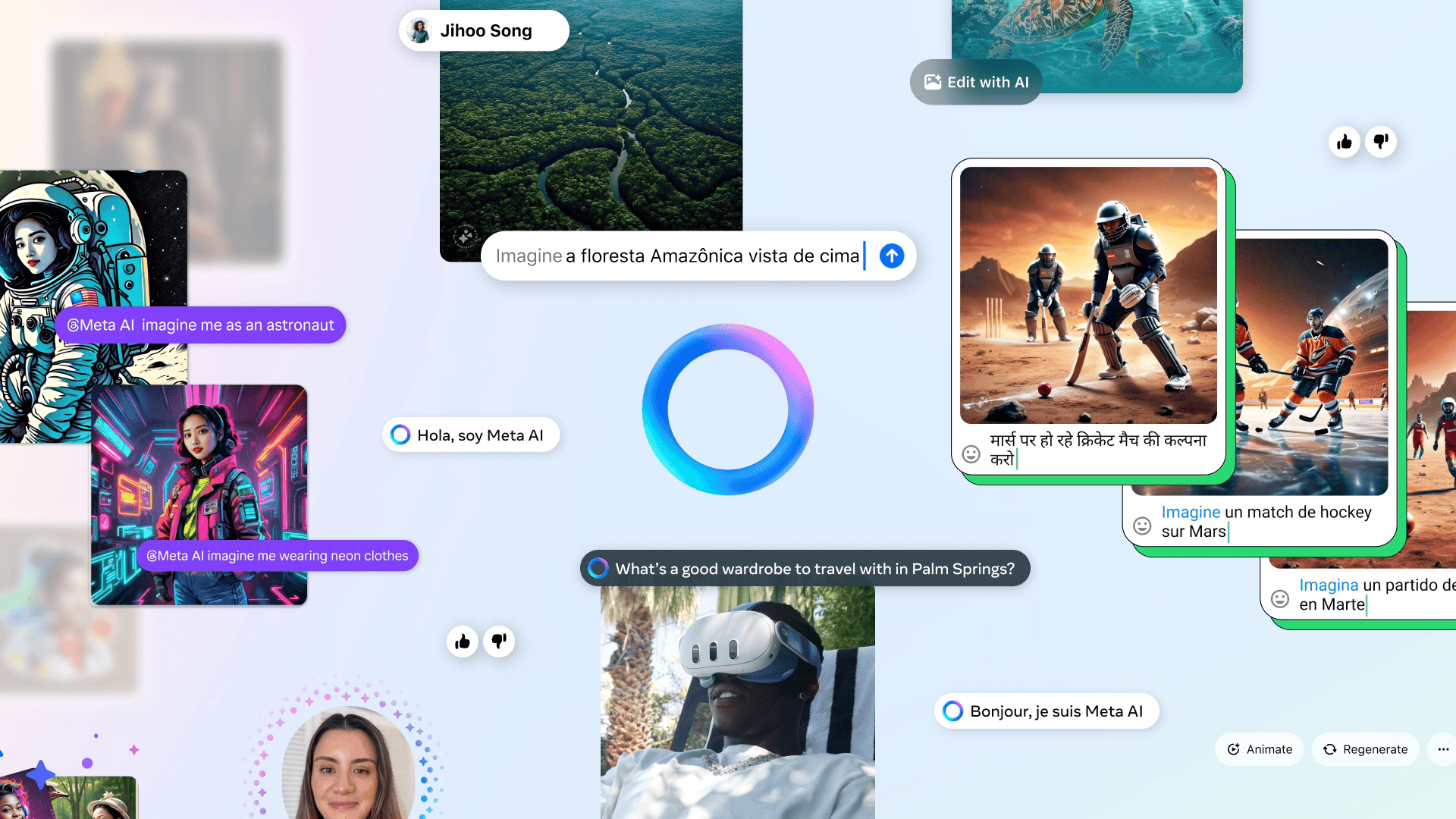

ნინა ოსტანინამ განაცხადა, რომ ხელოვნურმა ინტელექტმა დემოგრაფიული პოლიტიკის ვარიანტები „რა მოხდებოდა, თუ“ პრინციპის საფუძველზე უნდა მოახდინოს მოდელირება. მან დასძინა, რომ მთავრობა უკვე ამზადებს ექსპერიმენტს ხელოვნური ინტელექტის მმართველობაში დანერგვის მიზნით.

ექსპერტები ეჭვქვეშ აყენებენ ციფრული რეცეპტების ეფექტურობას

პროფესორმა ალექსანდრე საფონოვმა განმარტა, რომ შობადობას ეკონომიკა განსაზღვრავს და არა ალგორითმები. მან აღნიშნა: „ჩვენ უნდა შევქმნათ ინტერესი მოსახლეობაში“, მაგრამ ამავდროულად, „გარდავქმნათ ოჯახის გარშემო არსებული ეკონომიკური მდგომარეობა“. მისი აზრით, ხელოვნური ინტელექტი გააუმჯობესებს მოდელირებას, მაგრამ არ შეცვლის კრიზისის ფუნდამენტურ მიზეზებს.

„სახალხო ფრონტის. ანალიტიკის“ განყოფილების ხელმძღვანელი ოლგა პოზდნიაკოვა დაეთანხმა: ნეირონული ქსელები შესაფერისია პროგნოზებისთვის, რომლებიც ითვალისწინებს ეკონომიკურ პირობებს, განათლებას, ჯანდაცვას და სოციალურ განწყობას, თუმცა ძირითადი დემოგრაფიული მონაცემები კვლავ მნიშვნელოვანია.

რუსეთი ბოლო 200 წლის განმავლობაში ყველაზე ცუდ მაჩვენებლებს განიცდის

შობადობის შემცირება ისტორიული იყო: 2024 წელს ქვეყანაში 1.22 მილიონი ბავშვი დაიბადა - ყველაზე დაბალი მაჩვენებელი 1999 წლის შემდეგ. იანვრიდან მარტამდე დაბადებულთა რიცხვი კიდევ 11 500-ით შემცირდა. ამის შემდეგ, როსტატმა შეწყვიტა დეტალური მონაცემების გამოქვეყნება. ეროვნული პროექტი „დემოგრაფიაც“ ჩაიშალა: 2018-დან 2023 წლამდე სიკვდილიანობამ დაბადებულებს 3.4 მილიონი ადამიანით გადააჭარბა.