Վերջերս կայացած շնորհանդեսում XPeng-ը բացատրեցթե ինչու է իր նոր մարդանմանը՝ Iron-ը, ունի ակնհայտորեն կանացի տեսք։

Արտադրողը ներկայացրեց «Տերմինատոր» ոճի ռոբոտ՝ իրատեսական քայլվածքով, որը հրապարակայնորեն ցուցադրում էր իր մարմինը՝ հաստատելու համար ներսում մարդու բացակայությունը: Atlas-ի կամ Optimus-ի նման սովորական տղամարդկային մոդելների համեմատ, Iron-ը անմիջապես առանձնացավ, այդ թվում՝ իր անատոմիայով:.

Տեսողական ընտրության պատճառները

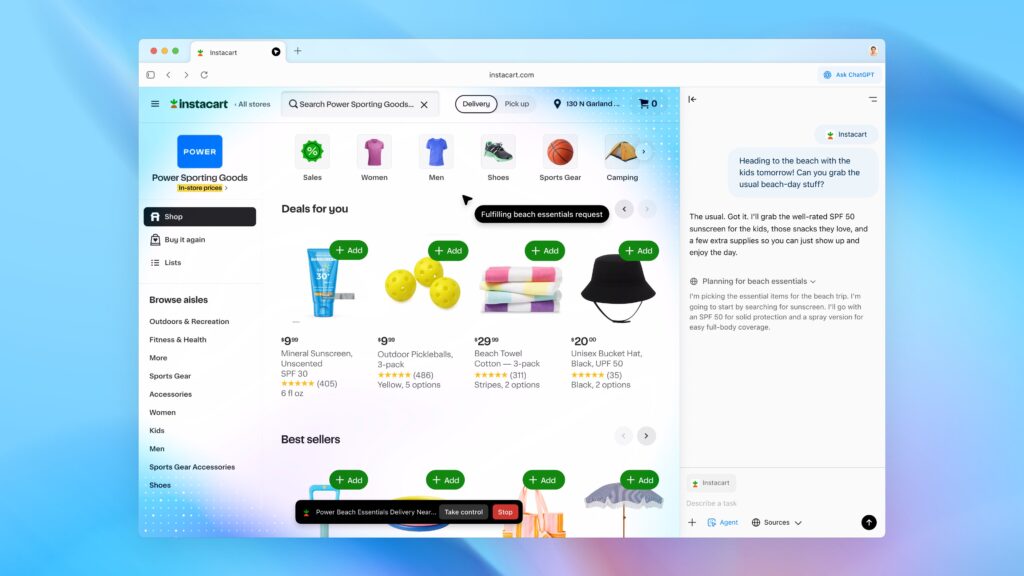

XPeng-ի գործադիր տնօրեն Սյաոպենգ Հեն ընդգծեց, որ ընկերությունը միտումնավոր ստեղծում է մարմնի անհատականացմամբ ռոբոտ։ Նա նշեց. «Դուք կարող եք ընտրել մի փոքր ավելի հաստ երկաթ կամ, ինչպես ես, ավելի բարակ երկաթ», ավելացնելով «ամբողջությամբ փափուկ մաշկով ծածկված ռոբոտի տարբերակը, որպեսզի այն դառնա ավելի տաք և մտերիմ»։ Նա հավելեց, որ գրավիչ տեսքը նպաստում է վաճառքի աճին, և կոնցեպտն ինքնին աստիճանաբար համապատասխանում է տեխնո-մտերիմության ի հայտ եկող միտմանը։.

Անհատականացումը որպես մարքեթինգային ռազմավարություն

Մշակողները նշում են, որ Iron-ը կարող է դառնալ «կյանքի ուղեկից» և գործել «ինչպես խելացի մարդ»։ Ռոբոտն ունի «82 աստիճան ազատություն» և «պոդիումի նման, նրբագեղ քայլվածք»։ XPeng-ը փորձարկումներ է անում հիբրիդային տեսողական լուծումներով՝ հասկանալու համար, թե որ ձևերն ու պարամետրերը կգրավեն լսարանին։ Ընկերությունը բացահայտորեն ընդունում է, որ ռոբոտների հարմարվելն ավելի հեշտ կլինի, եթե նրանք հնարավորինս մարդկային տեսք ունենան և շարժվեն։.

Սպասում ենք իրական մեկնարկին

Նա նշեց, որ XPeng-ը ուսումնասիրում է մարդկային ռեակցիաները տարբեր ձևաչափերի նկատմամբ և միտումնավոր փորձարկում է տարբեր մակարդակներով տեխնո-մտերիմության սցենարներ: Արտադրողը վստահ է, որ որքան շատ է ռոբոտը նման մարդու, այնքան ավելի հեշտ է այն ինտեգրվելու աշխատանքային գործընթացներին և առօրյա միջավայրերին: Այժմ մնում է տեսնել, թե արդյոք ֆունկցիոնալությունը, թե՞ տեսքը ավելի կարևոր կլինեն, քան Iron-ի շուկայական թողարկումը:.